Mi, 9. März 2022, Fabian Schaar

Im Dschungel der vielen, vielen GNU/Linux-Distributionen finden sich nur sehr wenige, die den Idealen freier Software vollkommen konsequent entsprechen. Die Free Software Foundation informiert auf ihrer Website über die Abwandlungen des Betriebssystems, die dem Gedanken freier Software am nächsten kommen. Eine dieser Distributionen ist Trisquel GNU/Linux.

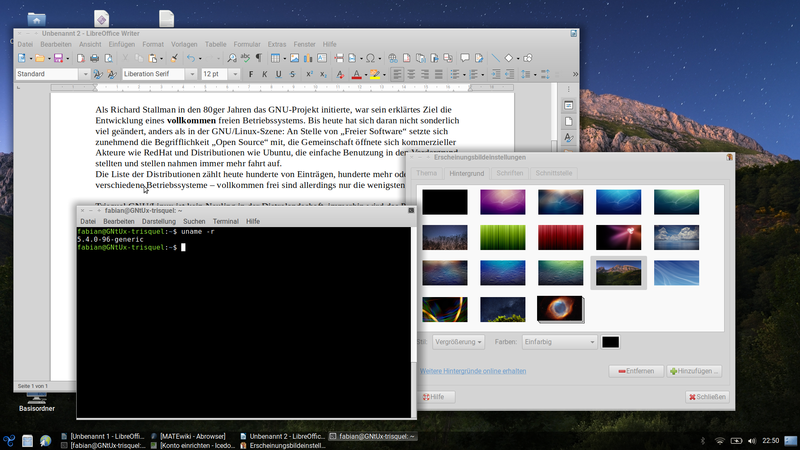

Als Richard Stallman in den 80er Jahren das GNU-Projekt initiierte, war sein erklärtes Ziel die Entwicklung eines vollkommen freien Betriebssystems. Bis heute hat sich daran nicht sonderlich viel geändert, anders als in der GNU/Linux-Szene: An Stelle von „Freier Software“ setzte sich zunehmend die Begrifflichkeit „Open Source“ durch; die Gemeinschaft öffnete sich kommerzieller Akteure wie RedHat und Distributionen wie Ubuntu, die einfache Benutzung in den Vordergrund stellten und stellen nahmen immer mehr Fahrt auf. Die Liste der Distributionen zählt heute hunderte von Einträgen, hunderte mehr oder minderverschiedene Betriebssysteme – vollkommen frei sind allerdings nur die wenigsten.

Trisquel GNU/Linux ist kein Neuling in der Distro-Landschaft, immerhin wird das Projekt schon seit 2007 entwickelt – während die erste Version noch auf Debian 4 aufsetzte, wechselte das Projekt relativ schnell zur Ubuntubasis. In dieser Hinsicht scheint Trisquel die Einfachheit und Nutzerfreundlichkeit von Ubuntu mit der konsequenten Umsetzung der Ideale freier Software kombinieren zu wollen. Die randvollen Repositories mit einer Aktualität auf dem Stand von Ubuntu 20.04 LTS veranlassten mich dazu, dem Projekt eine Chance zu geben – nicht nur auf einer virtuellen Maschine, sondern auf echter Hardware.

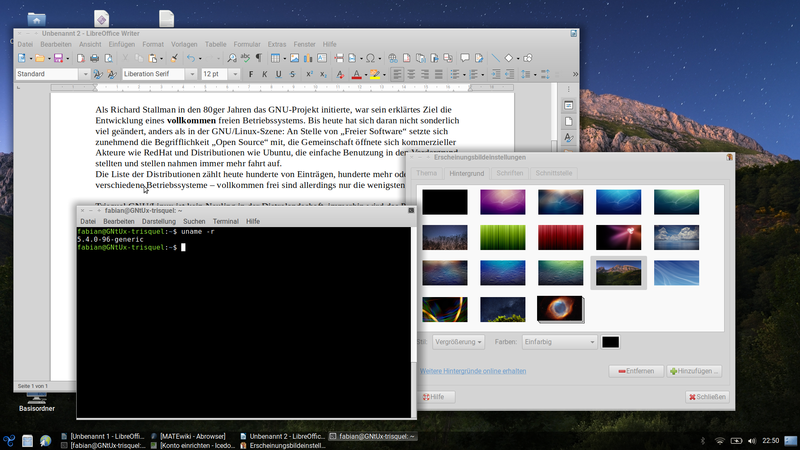

Kurzerhand habe ich also meine wichtigsten Dateien zusammengepackt, einen Livestick mit Trisquel GNU/Linux erstellt und installiert. Die Installation war hierbei wirklich einfach, immerhin setzt Trisquel standardmäßig auf den Ubiquity-Installer von Ubuntu. Nach der Installation begrüsst Trisquel neue Nutzer*innen mit einem doch sehr ansprechenden Desktop, standardmäßig ist das Mate. Mit seinem dicken Panel schafft die Distro eine praktische Oberfläche, natürlich nichts Extravagantes; aber doch praktisch. Wer die voreingestellten Pastellfarben des leicht angepassten Greybird-Themas („Trisquel“) nicht mag, kann neue installieren oder die CSS-Dateien der Themen anpassen. Trisquel bedient sich bekannter und beliebter Konzepte, schafft ein angenehmes Nutzungserlebnis und tauscht seine Ideale nicht gegen Bequemlichkeit.

Die Entwicklung des Betriebssystems kann als Dekommerzialisierung Ubuntus zugunsten der Freiheit der Nutzer*innen gesehen werden: Das Projekt stützt sich auf die Community und deren Spenden und ist organisiert als Non-Profit-Organisation.

Eine Besonderheit ist, wie oben schon erwähnt, die Auswahl der Software. Anstatt des Browsers Firefox kommt dessen augenscheinliche Abwandlung „Abrowser“ daher, aktuell in Version 97. Mozillas Thunderbird wird ersetzt durch IceDove, diese Bezeichnung könnte alt eingesessenen Debian-Nutzer*innen bekannt vorkommen. Was die Nutzung auswirkt, ergeben sich durch die Abwandlungen kaum merkliche Unterschiede.

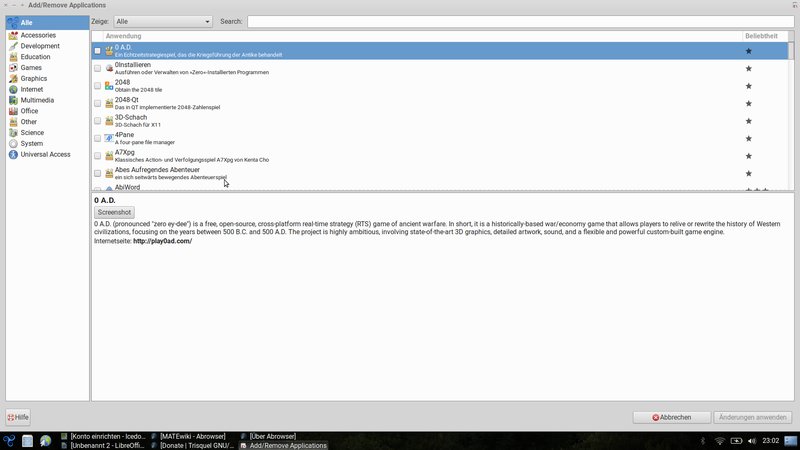

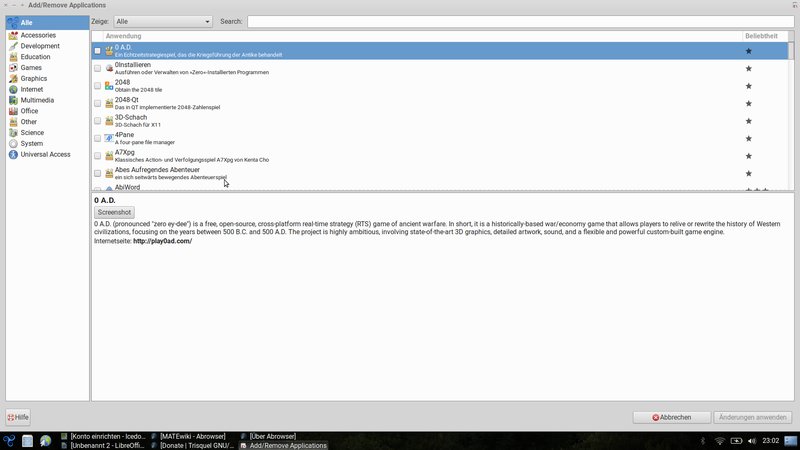

Bemerkenswert finde ich den Appstore, den Trisquel mitbringt: Hier haben die Distributor*innen eine angenehme, grafische Oberfläche zu schaffen. Über die Anwendung lassen sich leicht klassische .deb-Pakete aus den Repos installieren. Flatpak und Ubuntus Snap sind nicht vorinstalliert.

Die Softwareverwaltung ist gewohnt einfach, sie entspricht dem Standard bei debianbasierten Systemen. Wegen der geringen Verbreitung der Distro sind die Mirrors etwas weit entfernt und standardmäßig etwas behäbig, zumindest im deutschsprachigen Raum, wirklich schlimm ist das nicht.

Trisquels Alleinstellungsmerkmal ist und bleibt der besondere Fokus auf der Freiheit der Software. In der Folge werden keinerlei unfreie Anwendungen, Treiber usw. unterstützt. Um das WLAN auf dem Laptop zum Laufen zu kriegen, musste ich daher über die iwlwifi-firmware als .deb über Gdebi installieren. Hier ist Trisquel allerdings auch nicht sonderlich anders als die offizielle Ausgabe von Debian, die auch keine unfreien Pakete beinhaltet.

Meinen ersten Eindrücken zufolge ist Trisquel eine der vollkommen freien Distros, die verhältnismässig leicht genutzt werden können. Die Mission, die das Projekt im Sinne freier Software verfolgt, ist in der unübersichtlichen GNU/Linux-Szene doch bemerkenswert.

Sicher fragen sich jetzt die ein oder anderen, warum eine solche Distro überhaupt genutzt werden sollte, wenn man am Ende doch auf unfreie Firmware für das WLAN angewiesen ist. Diese Frage ist natürlich gerechtfertigt. Und doch sehe ich digitale Rechte mit Trisquel besser verteidigt als mit anderen GNU/Linux-Varianten, besser als bei denen, die gerne mal auf das„GNU“ im Namen verzichten. Trisquel hat sich als Projekt der freien Desktop-Software verschrieben, hat also ein konkretes Ziel. Bei anderen ist das nur eine Nebensache.

Meiner Ansicht nach kann es nicht schaden, wenn unfreie Software aus dem System so gut wie es geht fern gehalten wird. Weitere Beispiele, wo das Konzept gut aufgeht, sind Abrowser und IceDove. Allen, die auf unfreie Software verzichten wollen und können, kann ich Trisquel ans Herz legen. Zumindest in einer virtuellen Maschine ist das Ganze einen Versuch wert.

Trisquel erhält die Vision des GNU-Betriebssystems aufrecht. Eine Vision, die nicht vergessen werden sollte. Die Vision, dass sich die Anwender*innen von Software selbst befreien können.

Quelle: https://trisquel.info/de